Wiadomo, że Apple bardzo ważne jest zachowanie poufności danych, które przechodzą przez urządzenia w ekosystemie, oraz ich dobra ochrona przed wścibskimi oczami. Nie oznacza to jednak, że użytkownicy nie muszą przestrzegać zasad związanych z etyką, moralnością i człowieczeństwem.

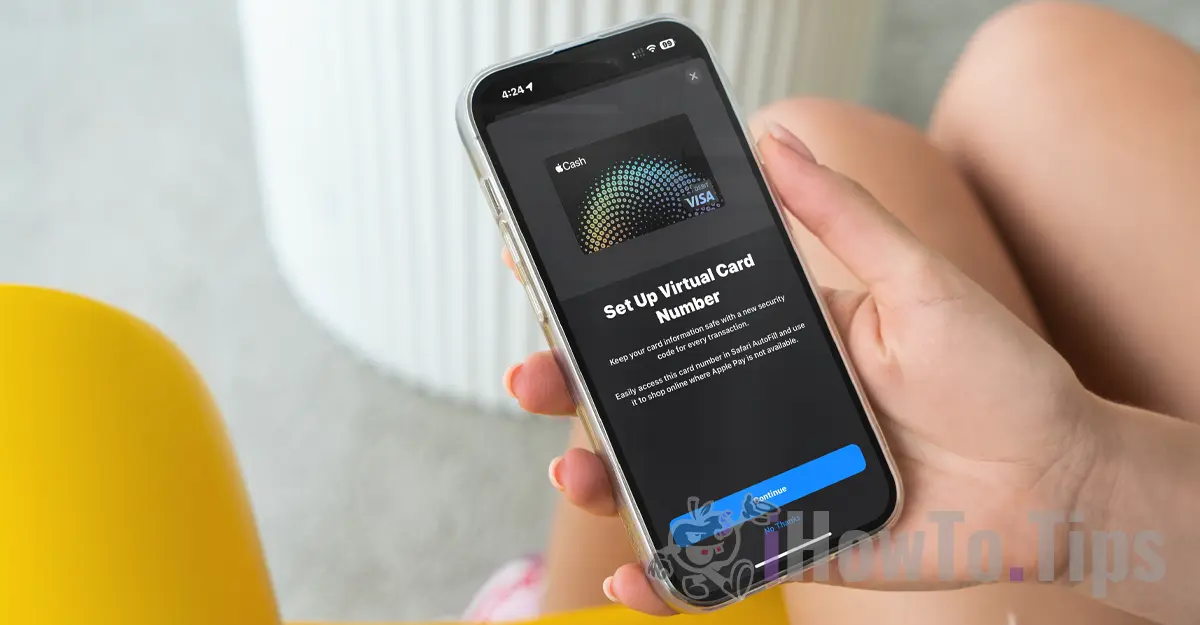

Apple ogłosił, że wkrótce uruchomi technologię zdolną do skanowania wszystkich obrazów przechowywanych przez użytkowników w iCloud oraz do identyfikacji zdjęć przedstawiających wykorzystywanie seksualne dzieci. Materiały dotyczące wykorzystywania seksualnego dzieci (CSAM).

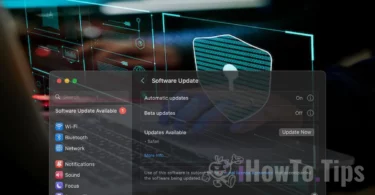

Ta technologia zostanie uruchomiona przez Apple pod koniec tego roku, najprawdopodobniej w wersji pilotażowej, dla niewielkiej liczby użytkowników.

Jeśli zastanawiasz się „gdzie jest poufność danych?”, dowiedz się, że wszystko, co otrzymujemy treści wideo / zdjęcie odbywa się to za pomocą zaszyfrowanego protokołu. Oprócz przechowywania danych w iCloud są zaszyfrowane, ale dostawcy takich usług mają klucz do zaszyfrowania danych. Tutaj mówimy nie tylko o Apple. Microsoft, Google i inne usługi przechowywania danych w cloud Robię to samo.

Przechowywane dane mogą zostać odszyfrowane i zweryfikowane, jeśli są wymagane w postępowaniu prawnym lub jeśli rażąco naruszają prawo. Na przykład te dotyczące aktów przemocy wobec dzieci i kobiet.

Aby zachować poufność użytkowników, firma wykorzystuje nową technologię o nazwie NeuralHash, która skanuje zdjęcia z iCloud i zidentyfikuje te, które zawierają przemoc wobec dzieci, porównując je z innymi obrazami w bazie danych.

Jest to nieco podobne do rozpoznawania twarzy lub inteligentnego rozpoznawania przedmiotów, zwierząt i innych elementów.

Technologia będzie w stanie skanować i weryfikować zdjęcia zrobione lub przesłane przez iPhone'a, iPada lub urządzenie Mac, nawet jeśli ulegną one zmianom.